这一过程中,最复杂,也是最耗人力物力的环节,始于一篇文章被标为“具有争议性”。由于第三方事实核查人员有限, Facebook正在改进算法,力求从不同维度分析浩如烟海的内容,让机器挑选可疑文章提交给第三方,提高认证效率。

比如,一篇文章是否被大量用户举报?它的转发量是否高得令人怀疑? 它是否有病毒式传播的潜力?搭配着使用的,还有Facebook已经运行了一年的内容分析系统,它通过分析用户的评论来判断文章本身的真实程度。

Facebook内部研究团队也没闲着,他们从新闻来源着手,分析网站域名,找出那些发布最初信息的私人网址,协助第三方查辨消息真伪。如可能让人误以为是《华盛顿邮报》官网“washingtonpost.com”的“washingtonpost.co”。

从以上渠道获取的具有争议性的文章,将被汇总到第三方事实核查机构手中。目前和Facebook合作的团队还有Snopes、 ABC News、 PolitiFact、 FactCheck.org、 美联社。这些机构都是Poynter’s国际事实核查网络的成员,他们赞同并遵守“事实核查者准则”,查证信息的方法与传统媒体原先做法相似。

甄别该文的来源和内容后,当确认它是假新闻,必须标注该文“无新闻来源”,并发布揭穿该文的另一篇文章,注明反驳文的来源。这些被确认为假新闻故事,会出现图2的提示框。但Facebook并不会阻止人们继续传播。由于这项功能现在只处于测试期,仅限部分实用英语的地区用户使用,且第三方人员有限,目前该功能针对的只是那些错得离谱的报道或网站。

Facebook目前对假新闻发布者的惩罚措施是,禁用其使用Facebook的广告服务。他们认为,很多假新闻是受经济利益驱使出现的,它们旨在吸引用户,获取流量和广告收益。如果减少了这种广告收益,就能减少假新闻的出现。Facebook表示,他们也会考虑对这些发布者采取别的措施,但暂时没有公布这些措施的具体内容。

新闻聚合网站,如国内的今日头条,近日也作出了算法的调整,对不实信息和谣言采取了行动。

用户最近5天在今日头条阅读过的内容,如果被证实为谣言,那么系统会通过辟谣机制,第一时间在页面的信息流中为用户展示一条辟谣信息。辟谣内容来源会首先选择权威媒体,以及事件的当事者。

据今日头条副总编徐一龙介绍,辟谣功能需要及其算法和人工共同合作,算法模型通过消息评论和用户举报等渠道的反馈,抓取符合谣言特征的内容,交由人工复审。如果大量用户举报一篇内容为虚假消息,或在某篇内容的评论区中密集出现“假新闻”等类似关键词,机器可自动识别并提交给今日头条审核团队,进入复审队列。

在确认为虚假信息后,系统会立刻停止虚假信息的推荐和展示,并依据平台运营规则对违规账号进行处罚。如果是影响范围很广的不实信息,今日头条的辟谣机制就会走到最后一步,精准推送辟谣内容。对于看过谣言的用户,系统会自动推荐辟谣文章,没看过的用户,系统会根据他的个性化阅读需求正常推荐,不会强推。

但与Facebook不同的是,今日头条没有传统媒体那样的编辑,徐一龙表示,他们有产品、运营、审核的同事,他们每天的重要工作就是调教算法,让算法进行更精准的分发。

但算法真的是解决一切问题的终极答案吗?

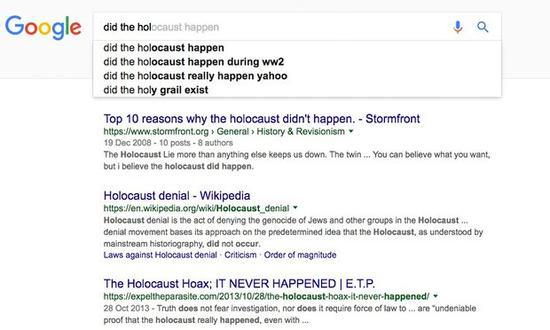

近日,Google受到口诛笔伐。因在其搜索框里输入“did the hol”时,竟自动填充了“did the Holocaust happen (犹太大屠杀是否存在)”选项,更糟糕的是,置顶结果竟然是一个新纳粹网站stormfront.org的文章,标题是“证明大屠杀没发生的十大理由 ”,维基百科的解释只排在第二位。